7 倍便宜、基准持平 Opus 4.7、开源——Kimi K2.6 正在改写 AI 编码的性价比叙事。附带可直接复制使用的 prompt 模板、隐藏命令和排障指南。

这是一份关于 Kimi K2.6 的完整拆解:它到底是什么、能做什么,以及为什么它正在悄悄成为最重要的编码模型,却几乎没人讨论。

但和你看过的每一篇「Kimi vs Claude」不同,这篇文章附带了可直接复制的 prompt、隐藏命令,和一套应对智能体漂移的排障指南。

> 收藏这篇,你会用到的。

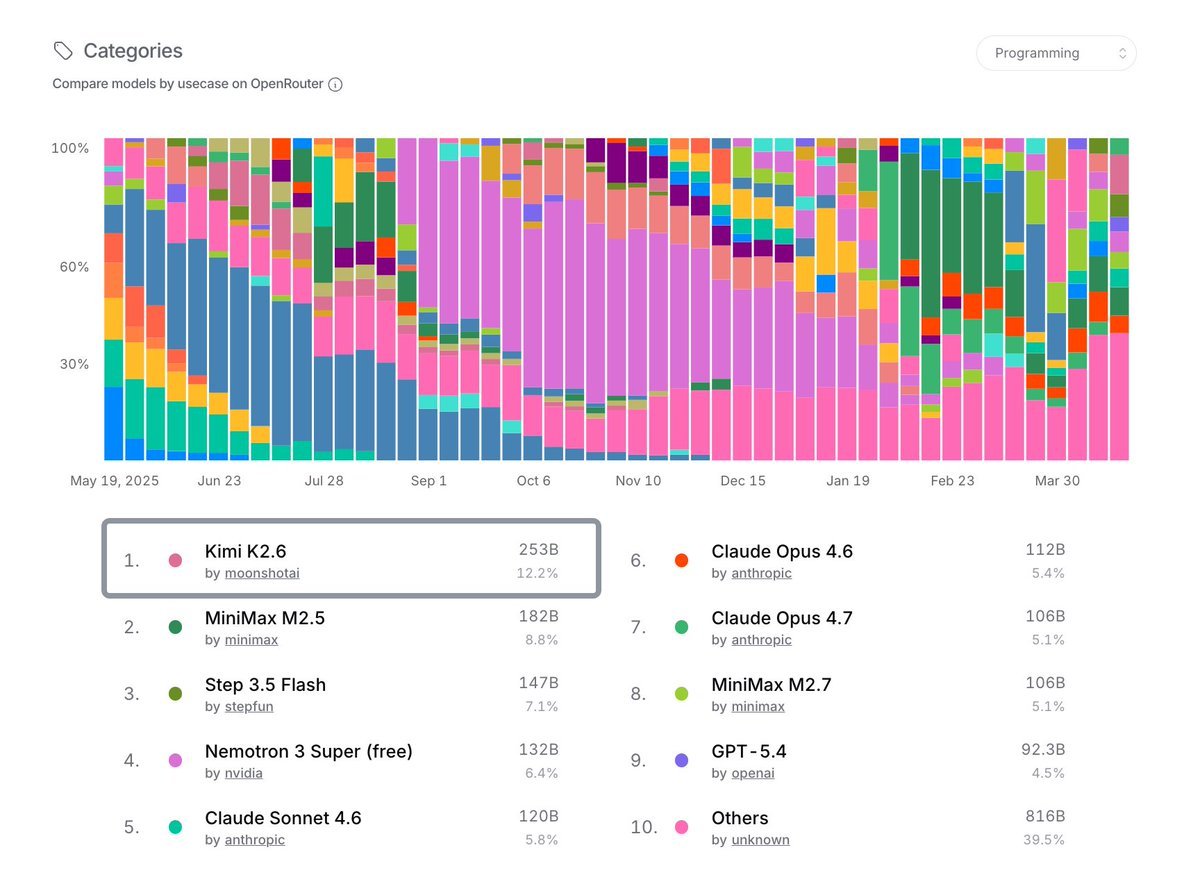

在谈代码之前,先看一组数字

Claude Opus 4.7 的价格:输入 $5.00/百万 token,输出 $25.00/百万 token。

Kimi K2.6:输入 $0.80,输出 $3.60。

便宜了 7 倍——而它在 SWE-Bench、Terminal-Bench 和真实编码智能体任务上的表现,与 Opus 4.7 平起平坐。

不是「对便宜货来说算不错」。是真的有竞争力。在某些任务上——更强。

看基准测试:

- SWE-Bench:与 Opus 4.7 持平

- Terminal-Bench:与 Opus 4.7 持平

- 长程智能体任务:在持续数小时的工作流中,超越 Opus 4.7

开源。通过 API 完整可用。已在 Kimi Code(他们的编码智能体)中运行。

Kimi Code 是什么?

Kimi Code 是 Kimi 的编码智能体——类似 Claude Code,但由 K2.6 驱动,访问地址 kimi.com/code。

它运行在你的终端和 IDE 里。它接受的是任务,而不只是问题。

编码助手和编码智能体的区别:

- 助手——你问,它答,你来实现。

- 智能体——你描述结果,它执行、迭代、修 bug、交付。

Kimi Code 做的是第二种。

5 个能省下数小时的隐藏命令

@ —— 打仗之前先画地图

在 Kimi 写第一行代码之前,让它先绘制整个代码库的版图。审查计划。修改。然后才执行。

@src/auth/middleware.ts @src/utils/token.ts

解释 token 刷新流程,并找出在快速重试时可能发生内存泄漏的位置。它做了什么:从你已索引的代码库中拉取实时定义。Kimi 读取实际文件,追踪 import 关系,动态构建上下文。

为什么重要:彻底消除了复制粘贴地狱。在一个 50 个文件的代码重构中,这能省下 30-40 分钟的手动上下文组装时间,并防止虚构的 import 路径。

进阶用法:链式引用多个符号:@AuthService.refresh @TokenStore.cleanup @APIClient.interceptors——Kimi 会自动跨文件连接这些点。

/explain —— 几天变几分钟,接手遗留代码

被扔进一个 5 年老的单体仓库?别读——审问它。

/explain @src/matching-engine/order-book.ts

重点关注:线程安全模型、内存分配模式、热路径起点。它做了什么:生成一份架构摘要,包含依赖追踪、复杂度热点分析和数据流图。

为什么重要:高级工程师通常需要花 2-3 天手动绘制遗留系统地图,才能安全触碰代码。/explain 把这个过程压缩到 10 分钟。你拿到了「部落知识」,却不需要找到那个部落。

什么时候用:任何你害怕破坏隐式不变量的重构之前。

.kimi/rules —— 编程你的智能体,别再重复自己

厌倦了每次会话都要说「用 strict mode」和「别碰 /legacy 目录」?把它刻进项目的 DNA 里。

# .kimi/rules

- 始终使用 TypeScript strict 模式;不允许 implicit any

- HTTP 调用使用 @utils/api-client 的 retry-wrapper,禁止裸 fetch

- /legacy/ 目录只读,除非显式覆盖

- 优先使用函数式 React 组件;使用 class 组件需要说明理由它做了什么:创建持久化的项目级指令。Kimi 在每次会话开始时自动加载这些规则。

为什么重要:统一整个团队的输出质量。消除了「糟糕,它用了错误的模式」的返工循环。在一个 10 人团队中,每天能节省集体数小时的时间。

进阶用法:把 .kimi/rules 纳入版本控制,和代码库一起管理。它变成了真正能自我执行的活文档。

检查点提示法 —— 为 6 小时长会话上保险

K2.6 的杀手锏是耐力。但没有路标的耐力,就是等着崩溃。

每次优化迭代后,输出:

- [第 N 轮] 改动内容

- [性能] 当前吞吐量 vs 基线

- [阻塞] 下一步的阻碍是什么

- [状态] 修改了哪些文件、测试状态、已知风险它做了什么:强制 Kimi 在指定间隔输出结构化的状态报告。

为什么重要:如果你的终端在第 5 小时崩溃,你失去的是心智模型,而不仅仅是输出。检查点让你可以从任意节点 --resume(或手动重建上下文)。在一次 12 小时的优化运行中,这就是恢复和重来的区别。

什么时候用:任何预计超过 30 分钟或涉及超过 10 次工具调用的会话。

/test —— 产出覆盖率,不只是代码

写函数只是完成了一半。证明它是对的,才是另一半。

/test @src/matching-engine/order-matcher.ts

重点关注:订单取消和撮合之间的竞态条件、quantity * price 的溢出它做了什么:分析你的实现,找出你遗漏的边缘情况,模拟依赖,生成测试脚手架。

为什么重要:开发者 30-50% 的时间花在写测试上。/test 在 2 分钟内产出 80% 覆盖率,包括人类会忘记的那些棘手边缘情况(null、溢出、并发访问)。

升级用法:生成后用 /review 做第二轮审查——「重点关注测试盲区:哪些行为还没被断言?」——强迫它对自己的测试套件再做一次扫荡。

说实话

没有什么 /godmode。没有 /unlock。Kimi Code 真正的「隐藏」能力不是秘密命令——

而是可组合性:@ 提供上下文,.kimi/rules 保证一致性,检查点提示法提供韧性。

把这三种方法组合用在一个长程任务上,你就能得到让 K2.6 感觉像是另一种物种的、长达 12 小时的自主编程会话。

Kimi 2.6 和其他「便宜的 Claude 替代品」到底有什么不同

大多数廉价模型都会在同一个地方翻车:长程任务。

一个文件的修改没问题。但当任务需要——

- 跨几十个文件维持上下文

- 在执行过程中做架构决策

- 在没有人类干预的情况下从错误中恢复

- 连续运行数小时而不漂移

——它们就崩了。

Kimi 2.6 是专门为此训练的。以下是证据。

案例一:Mac 上的 Zig 推理优化

任务:在 Mac 上下载并本地部署 Qwen3.5-0.8B。用 Zig(一种极其小众的系统语言)实现推理。优化吞吐量。

结果:

- 4,000+ 次工具调用

- 12+ 小时连续执行

- 14 轮优化迭代

- 起始吞吐量:~15 token/秒

- 最终吞吐量:~193 token/秒

比 LM Studio 快了 20%。没有人工干预。用一种大多数模型训练数据极少的语言完成。

案例二:金融撮合引擎大修

任务:取 exchange-core——一个 8 年历史的开源金融撮合引擎——优化到其理论极限。

结果:

- 13 小时连续执行

- 12 种优化策略部署

- 1,000+ 次工具调用

- 4,000+ 行代码修改

模型分析了 CPU 和内存火焰图,在线程拓扑中找出了隐性瓶颈,重构了核心执行循环。

性能影响:

- 中等吞吐量:0.43 → 1.24 MT/s(+185%)

- 峰值吞吐量:1.23 → 2.86 MT/s(+133%)

这个引擎已经运行在接近性能极限。K2.6 找到了人类维护者几年来都未曾发现的优化空间。

这不是代码补全。这是工程。

为什么 Kimi 2.6 在实践中比 Claude 更强

三个原因。

1. 更少的步骤,同样的结果。

Kimi 2.6 用比 Kimi 2.5 少约 35% 的步骤达到更好的结果。更少步骤意味着更少 token。更少 token 意味着更低成本和更快执行。

2. 更好的指令遵循。

大多数编码智能体失败是因为漂移——它们开始解决一个问题,然后逐渐转去解决另一个。Kimi 2.6 保持在约束范围内,保全项目结构,在出错后恢复而不丢失原始意图。

Augment Code 的 CTO 将其描述为「在大代码库中的外科手术式精准」。

3. 对真实 API 和工具的理解更好。

Kimi 2.6 对第三方框架、真实 API 和工具交互的理解有显著提升。在生产使用中,这是「能用的智能体」和「需要不断纠正的智能体」之间的分界线。

如何安装 Kimi Code

需要:

- 一台电脑(Mac、Windows 或 Linux)

- 终端访问

- Kimi 账号——kimi.com

第 1 步——安装 Kimi Code

Mac/Linux:

curl -LsSf https://code.kimi.com/install.sh | bashWindows(PowerShell):

Invoke-RestMethod https://code.kimi.com/install.ps1 | Invoke-Expression验证安装:

kimi --version> 由于 macOS 安全检查(Gatekeeper),首次运行 kimi 命令可能较慢。可以在「系统设置 → 隐私与安全性 → 开发者工具」中添加你的终端应用,以加速后续启动。

如果你已安装 uv,也可以:

uv tool install --python 3.13 kimi-cliKimi Code CLI 支持 Python 3.12–3.14,推荐使用 Python 3.13 以获得最佳兼容性。

第 2 步——认证

kimi login会打开浏览器窗口。用 Kimi 账号登录。

第 3 步——进入你的项目

cd your-project

kimi搞定。Kimi Code 现在已经运行在你的项目里了。

首次启动时,输入 /login 配置 API 源。

第 4 步——给它一个任务

不要问问题。给它结果。

不要说:「如何优化这个函数?」

要说:「分析支付处理模块的性能瓶颈,重构使平均响应时间至少降低 30%。每次改动后运行完整测试套件。」

K2.6 会执行、测试、迭代、报告。

3 个实战验证过的 Prompt(直接复制可用)

Prompt 1:带约束的重构

分析 [模块名称] 的性能瓶颈。

重构使响应时间降低 30%。

不要修改公开 API 或函数签名。

每次改动后运行完整测试套件。

报告:改动前指标、改动后指标、具体改动内容。

如果遇到错误,停下来询问再继续。最适合:遗留代码优化、保持 API 兼容的重构。

Prompt 2:多文件架构变更

在 [文件A]、[文件B]、[文件C] 中实现 [功能描述]。

保持与现有调用方的向后兼容。

为所有新代码路径添加单元测试。

更新 README.md 描述新功能。

如果发现当前架构无法干净地支持这个需求,先提出 2 个备选方案再选择。最适合:涉及多个层次的功能新增。

Prompt 3:深度调试

[粘贴完整错误 trace]

这个错误在 [描述上下文] 时发生。

找到根本原因——不是表面症状。

在源头修复。

用测试验证。

不要打补丁或压制错误。

修复后用 2 句话解释根本原因。最适合:顽固 bug、竞态条件、内存问题。

迭代循环:别接受第一版输出

最好的工程师不会直接交付 v1。你的智能体也不该。

对每个重要任务使用这个模式:

第 1 步:生成——Kimi 写出第一版

第 2 步:评估——你运行测试 / 检查指标 / 验证行为

第 3 步:诊断——把结果反馈给它:"测试 X 失败,因为 Y"

第 4 步:改进——Kimi 修复

第 5 步:重复——直到所有阈值通过阈值规则:永远不要说「改得更好一点」。要说「测试必须通过,覆盖率不能下降,响应时间必须低于 200ms」。

对抗性压力:通过后,再加一轮:

现在批判你自己的方案。找出高级工程师会标记的 3 个弱点。修复它们。这就是 15 token/秒变成 193 token/秒的方式。不是一次完成。是 14 轮迭代。

Kimi Code 翻车了怎么办:排障指南

故障 1:漂移(Drift)

症状:Kimi 开始解决一个不是你给的问题。

修复:每个 prompt 开头加作用域锁定:

作用域:[具体模块/文件/行为]。不要修改此作用域之外的任何内容。如果仍然漂移,使用 /compact 并重新陈述原始任务。

故障 2:上下文坍缩

症状:2+ 小时后,Kimi 忘记了原始架构约束。

修复:

1. 在项目根目录创建 CONSTRAINTS.md。Kimi 会自动读取。 2. 会话中途使用 /compact Focus on [原始目标]。 3. 对于 6+ 小时任务,拆分成子会话并用 --resume。

故障 3:静默回归

症状:测试通过了,但别的东西坏了。

修复:在 prompt 中加入:

运行完整测试套件,不是只跑受影响的测试。

确认没有无关测试失败。故障 4:过度工程化

症状:你只想要改 3 行,Kimi 重写了整个模块。

修复:明确限定范围:

只做最小必要修改。不要重构无关代码。故障 5:工具调用失败

症状:Kimi 尝试运行命令,静默失败,然后继续。

修复:添加:

每次 shell 命令执行后,验证输出。

如果命令失败,停下来报告错误。Kimi Code 最擅长什么

基于 K2.6 的基准测试表现和真实企业测试:

- 长程重构——跨多文件、数小时的任务,要求模型在数千行代码中保持架构一致性。

- 性能优化——性能分析、瓶颈识别、迭代改进。上面的 exchange-core 和 Zig 推理案例都是真实例子。

- 多语言项目——K2.6 在 Python、Rust、Go、TypeScript 以及小众语言(Zig、Lua 等)上表现强劲。

- API 集成任务——将你的代码库连接到外部服务、处理边缘情况、调试 API 行为。

- DevOps 和基础设施——Vercel 在 Next.js 基准测试上看到了 50%+ 的提升。Fireworks AI 注意到了稳定、自主的智能体流水线。

用 Kimi 2.6 做 Vibe Coding

用 Kimi 2.6 做 vibe coding(氛围编程,指用自然语言描述需求、由 AI 完成编码的编程方式)是一种不同于大多数模型的体验。

你不需要是开发者也能有效使用它。你需要知道你想构建什么。

Kimi 2.6 可以在一次会话中把一个描述变成一个可用的全栈应用——前端、数据库、认证——全部搞定。

Kimi Websites 功能展示了这一点:落地页、交互工具、Web 应用,全来自一个 prompt。

但除了 Web 应用,它的编码智能体还能处理真正的工程工作。那种通常需要高级开发者花上好几天才能完成的活。

一个独立创始人可以用 Kimi Code + Kimi Claw 的群聊功能运行完整的工程流程——把任务路由到专门的智能体,每个装载各自的技能集,由 Kimi 2.6 协调。

这就是一人公司,团队级产出。

Vibe Coding Prompt:一次会话构建全栈应用

复制粘贴即可。它真的能跑。

构建一个任务管理应用,包含:

前端:

- Next.js 14 使用 App Router

- Tailwind CSS + shadcn/ui 组件

- 暗色模式支持

- 响应式布局(移动端 + 桌面端)

后端:

- SQLite 数据库,通过 Drizzle ORM

- tRPC 实现类型安全的 API 路由

- Zod 校验所有输入

认证:

- GitHub OAuth 2.0 登录

- 受保护路由中间件

功能:

- 创建 / 编辑 / 删除任务

- 任务优先级(低/中/高)

- 截止日期与日历选择器

- 按状态和优先级过滤

- 按标题搜索

部署:

- 配置 Vercel 部署

- 包含 vercel.json 和环境变量示例

流程:

1. 初始化项目(Next.js + 所有依赖)

2. 设置数据库 schema 和迁移

3. 实现认证流程

4. 构建所有 CRUD 操作

5. 构建带加载状态的 UI

6. 为关键路径编写并运行测试

7. 如果任何步骤失败,调试并重试

不要问我问题。做合理的决定。

准备好了之后报告本地开发 URL。预期结果:20-45 分钟内产生一个能跑的应用。

成本论证——为什么这比基准测试更重要

基准测试告诉你什么是可能的。成本告诉你什么是可持续的。

如果你在规模化运行 AI 编码智能体——跨团队、跨项目、每天数千次 API 调用——Opus 4.7 和 K2.6 之间的成本差异不是边际的。

以每天 100 万输出 token 计算——对一个活跃的编码智能体来说,这是合理的使用量:

- Claude Opus 4.7:$25/天 → $750/月

- Kimi K2.6:$3.60/天 → $108/月

同样的任务。同样的输出质量层级。月度成本差 7 倍。

对于一个同时运行多个智能体的团队来说,这个差距会迅速放大。

开源的优势

Kimi K2.6 完全开源。

这很重要,三个原因:

1. 你可以自部署。 在自己的基础设施上运行。没有 API 依赖。没有用量上限。完全控制你的数据。

2. 你可以微调。 基础模型可用于特定领域任务的定制——法律、医疗、专有代码库。

3. 社区速度。 开源模型改进更快,因为整个开发者生态都在贡献工具、集成和基准测试。

已支持:

- Ollama——完整的 K2.6 集成

- OpenCode——原生运行 K2.6

- OpenClaw——使用 K2.6 作为 Kimi Claw 的默认模型

- vLLM / llama.cpp——兼容的推理后端

结论

关于 AI 编码的主流叙事很简单:Claude 是最好的。花多少钱都值。

K2.6 打破了这种叙事。

开源。便宜 7 倍。基准测试与 Opus 4.7 持平。在 Vercel、Fireworks、Augment Code 等十几家公司中经受了生产验证。

问题不是 K2.6 够不够好。

问题是,你为什么还在多付 7 倍的钱。

链接

- 试用 Kimi Code:kimi.com/code

- K2.6 技术博客:kimi.com/blog/kimi-k2-6

- Kimi Websites(Vibe Coding):kimi.com/websites

- Agent Swarm:kimi.com/agent-swarm

- Kimi Claw:kimi.com/bot

- 我的 Telegram:t.me/kirillk_web3

- 我的 X:@kirillk_web3